Introl Blog

**

Introl Blog **

Japans 135 Milliarden Dollar teure KI-Revolution: Quanten- und GPU-Infrastruktur

Japans ¥10 Billionen KI-Vorstoß treibt 2,1GW-Rechenzentren und 10.000+ GPU-Einsätze an. Die Konvergenz von Regierung und Unternehmen in Höhe von 135 Mrd. USD schafft Asiens Quanten-KI-Kraftwerk.

Südkoreas 65-Milliarden-Dollar-KI-Revolution: Wie Samsung und SK Hynix den Boom der GPU-Infrastruktur in Asien anführen

Südkorea investiert bis 2027 65 Milliarden US-Dollar in die KI-Infrastruktur, wobei Samsung und SK Hynix 90 % des weltweiten HBM-Speichers kontrollieren. Rechenzentren mit einer Leistung von 3 Gigawatt, 15.000 GPU-Einsätze und Partnerschaften mit AWS, Microsoft und NVIDIA machen Seoul zur KI-Hauptstadt Asiens.

Flüssigkeitskühlung vs. Luft: Der 50kW-GPU-Rack-Leitfaden (2025)

GPU-Racks stoßen an thermische Grenzen von 50 kW. Flüssigkühlung bringt 21 % Energieeinsparung und 40 % Kostenreduzierung. Unverzichtbarer Leitfaden für KI-Infrastruktur-Teams, die vor der Wand stehen.

Indonesiens KI-Revolution: Wie die größte Volkswirtschaft Südostasiens zu einem globalen KI-Powerhouse wurde

Indonesien ist mit 92 % weltweit führend bei der Einführung von KI und wird bis 2030 einen Markt von 10,88 Mrd. USD haben. Tech-Giganten investieren Milliarden in die Infrastruktur, während lokale Start-ups die einheimische Innovation in Südostasiens größter Volkswirtschaft vorantreiben.

Wie Isambard-AI 5.448 Grafikprozessoren in 4 Monaten einsetzte: Die neue Blaupause für KI-Infrastruktur

Der rekordverdächtige Einsatz von 5.448 NVIDIA-Grafikprozessoren bei Isambard-AI zeigt, warum moderne KI-Infrastrukturen spezielles Fachwissen in den Bereichen Flüssigkeitskühlung, hohe Leistungsdichte und komplexe Netzwerke erfordern.

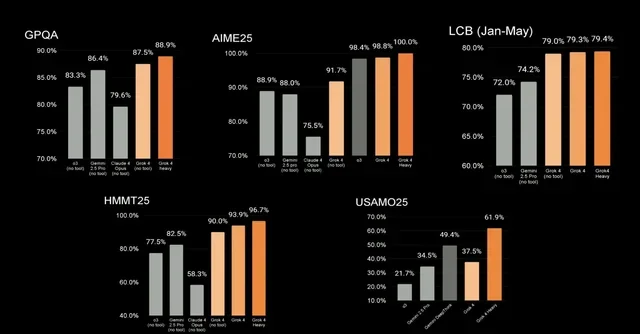

Grok 4 hat gerade die KI-Grenze gesprengt - warum das alles ändert

Grok 4 von xAI erzielt mit seiner 200.000-GPU-Infrastruktur noch nie dagewesene Benchmark-Ergebnisse und verdoppelt die Leistung von Wettbewerbern bei kritischen Argumentationstests. Der einzigartige Multi-Agenten-Ansatz des Modells und die Integration mit der CFD-Software von Tesla signalisieren einen Wechsel von KI-Assistenten zu echten Denkpartnern. Drei Wochen nach der Markteinführung berichten die Entwickler von Fähigkeiten, die unsere Herangehensweise an das Lösen komplexer Probleme verändern.

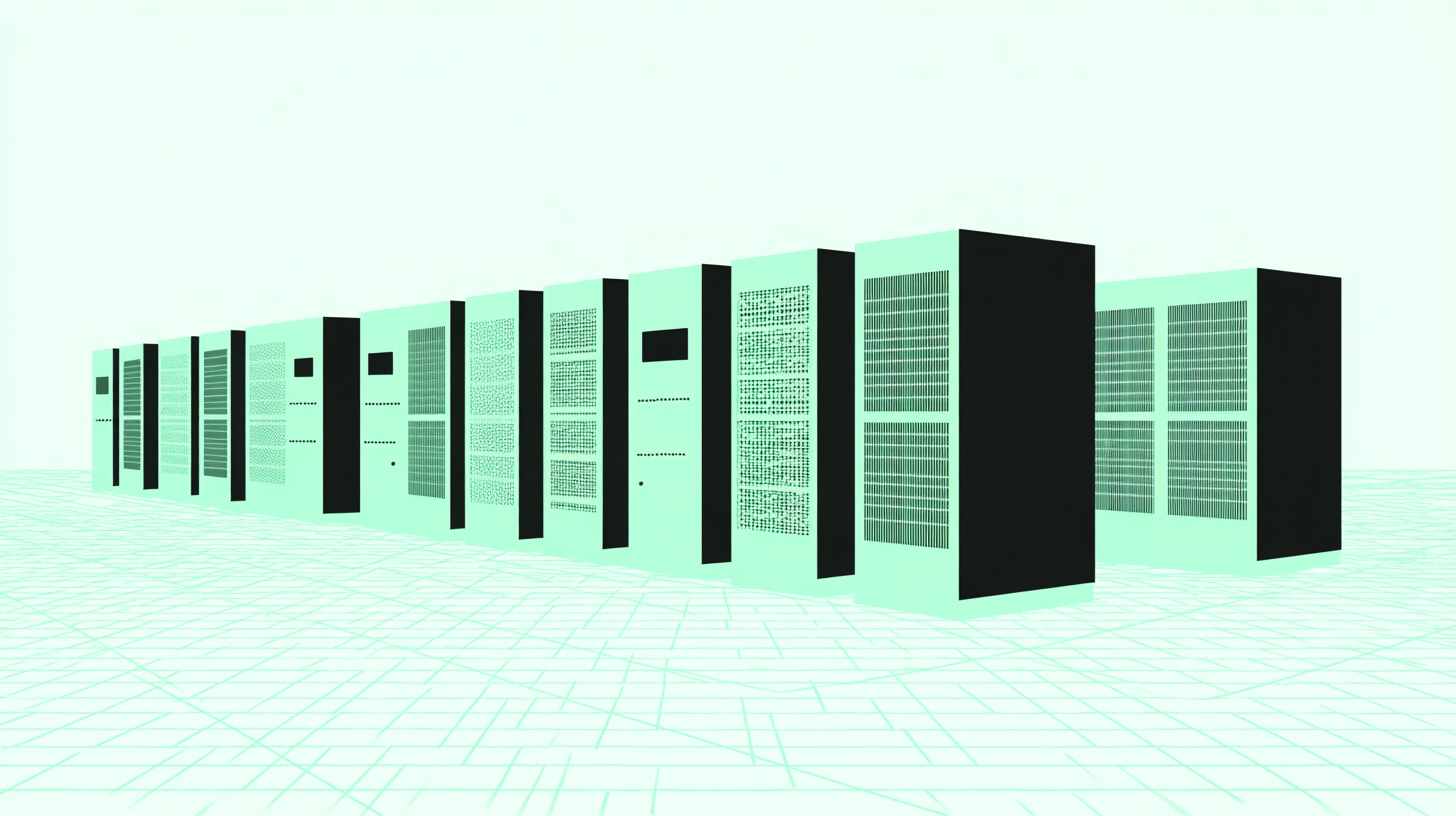

Warum KI-Rechenzentren nicht mehr so aussehen wie noch vor zwei Jahren

NVIDIAs Energieglättung reduziert den Netzbedarf um 30 %. Die Flüssigkeitskühlung bewältigt 1.600-W-GPUs. Clevere Unternehmen erzielen einen ROI von 350 %, während andere mit Ausfallraten von 80 % zu kämpfen haben.

Der Bau von Rechenzentren unter dem Aspekt der Nachhaltigkeit: Was funktioniert

Rechenzentren treiben unsere digitale Welt an, verbrauchen aber enorme Ressourcen. Lernen Sie bewährte Strategien für ein nachhaltiges Design kennen - von Flüssigkeitskühlung und Wassersparen bis hin zu intelligenter Standortwahl und umweltfreundlichem Bauen -, die Kosten senken und gleichzeitig ESG-Ziele erfüllen.

Strukturierte Verkabelung vs. flüssigkeitsgekühlte Kabelkanäle: Planung für Racks mit 100 kW und mehr

Da KI-Workloads die Rack-Dichte auf über 100 kW erhöhen, müssen Rechenzentren sowohl die strukturierte Verkabelung für den Datenfluss als auch die Flüssigkeitskühlung zur Wärmeabfuhr beherrschen. Erfahren Sie, wie Sie eine Infrastruktur entwerfen, die GPUs mit Spitzenleistung laufen lässt.

Warum der NVIDIA GB300 NVL72 (Blackwell Ultra) wichtig ist 🤔

Der GB300 NVL72 von NVIDIA bietet mit 72 Blackwell Ultra-GPUs, 288 GB Speicher pro GPU und 130 TB/s NVLink-Bandbreite 1,5 Mal mehr KI-Leistung als der GB200. Im Folgenden erfahren Sie, was Techniker über Stromversorgung, Kühlung und Verkabelung für diese 120-kW-KI-Rechenzentrumsschränke wissen müssen.

Skalierbare Vor-Ort-Besetzung: Einführung kritischer Infrastrukturen in Hyperspeed

Der KI-Boom führt zu einer noch nie dagewesenen Nachfrage nach Rechenzentrumsinfrastruktur, aber mehr als die Hälfte der Betreiber sieht sich einem kritischen Personalmangel gegenüber, der das Kapazitätswachstum gefährdet. Das Workforce-as-a-Service-Modell von Introl liefert zertifizierte Techniker innerhalb von Tagen - nicht Monaten - und ermöglicht es Hyperscale-Standorten, schnell zu starten und gleichzeitig die täglichen Opportunitätskosten von mehr als 5 Millionen US-Dollar zu vermeiden, die durch Verzögerungen entstehen.

Mapping the Future: Wie die globale Abdeckung den Einsatz von KI-Infrastrukturen verändert

Wenn Ihr 50.000-GPU-Cluster um 3 Uhr morgens in Singapur abstürzt, bedeutet der Unterschied zwischen einer 4-stündigen und einer 24-stündigen Reaktion monatelange verlorene Forschungsarbeit. Entdecken Sie, wie die 257 globalen Standorte von Introl die geografische Abdeckung in einen Wettbewerbsvorteil für die KI-Infrastrukturbereitstellung verwandeln.

H100 vs. H200 vs. B200: Die Auswahl der richtigen NVIDIA-GPUs für Ihre KI-Arbeitslast

Die NVIDIA-Grafikprozessoren H100, H200 und B200 erfüllen jeweils unterschiedliche Anforderungen an KI-Infrastrukturen - vom bewährten Arbeitstier H100 über den speicherstarken H200 bis hin zum bahnbrechenden B200. Wir erläutern die realen Leistungs-, Kosten- und Stromverbrauchsanforderungen, damit Sie den richtigen Grafikprozessor für Ihre spezifische Arbeitslast und Ihr Budget auswählen können.

Abmilderung der Kosten von Ausfallzeiten im Zeitalter der künstlichen Intelligenz

Erfahren Sie, wie Unternehmen durch vorausschauende Fehleranalyse und Remote-Hands-Verträge bis zu 500.000 US-Dollar pro Stunde an Ausfallkosten sparen können. Entdecken Sie ROI-Strategien zum Schutz von KI- und HPC-Investitionen mit einer detaillierten Fallstudie, die 20 % Rendite zeigt.

NVIDIAs Revolution auf der Computex 2025: Verwandlung von Rechenzentren in KI-Fabriken

Die Keynote von NVIDIA-CEO Jensen Huang auf der Computex 2025 war nicht nur eine weitere Produktvorstellung - sie war die Blaupause für die dritte große Revolution im Computerbereich. Während sich Rechenzentren in Token-produzierende "KI-Fabriken" verwandeln, schaffen die neuesten Innovationen von NVIDIA in den Bereichen Netzwerke, Unternehmens-KI und Robotik die Voraussetzungen für ein neues wirtschaftliches Paradigma, in dem Computerintelligenz so grundlegend wird wie Strom. Tauchen Sie ein in unsere umfassende Analyse, wie diese Entwicklungen die Computing-Strategie von Unternehmen verändern werden und was dies für Ihre Infrastruktur-Roadmap bedeutet.

Die Kunst des digitalen Abbruchs: Die Stilllegung von Hochleistungsrechenzentren mit Präzision und Ziel

Bei der Stilllegung eines HPC-Rechenzentrums geht es nicht nur darum, Server auszustecken - es handelt sich um eine Operation mit hohem Risiko, die chirurgische Präzision und militärische Planung erfordert. Von der Bereinigung unternehmenskritischer Daten bis hin zur Extraktion von Komponenten, die mehr wert sind als Luxusautos, führt Sie dieser Leitfaden durch den gesamten Prozess der Demontage digitaler Festungen, ohne dass es zu Sicherheitsverstößen, Verstößen gegen die Compliance oder Geldverschwendung kommt. Ganz gleich, ob Sie in die Cloud migrieren oder Ihre Infrastruktur aufrüsten, erfahren Sie, wie Sie eine potenzielle organisatorische Migräne in ein Musterbeispiel für technische Exzellenz und ökologische Verantwortung verwandeln können.

Das Global Network Shell Game: Überleben im grenzüberschreitenden Regulierungschaos

Sie betreiben eine internationale Netzinfrastruktur? Sie spielen ein Pokerspiel mit hohen Einsätzen, bei dem jedes Land ein anderes Kartenspiel ausspielt. Dieser unmissverständliche Leitfaden bahnt sich seinen Weg durch das Chaos der widersprüchlichen grenzüberschreitenden Compliance-Anforderungen und bietet kampferprobte Strategien für Netzwerkarchitekten, die ihre Systeme ohne Leistungseinbußen konform halten müssen. Von kryptografischen Konflikten bis hin zu Albträumen bei der Datenlokalisierung - entdecken Sie, wie Sie sich im globalen Minenfeld der Vorschriften zurechtfinden, ohne Ihre Infrastruktur zu zerstören.

Der 'Green Swap' - Mobilisierung von Klimafinanzierung für maximale globale Wirkung

Da die künstliche Intelligenz weltweit eine beispiellose Nachfrage nach Rechenzentren auslöst, bietet das innovative "Green Swap"-Konzept eine Lösung, um technologischen Fortschritt und Klimaziele miteinander in Einklang zu bringen. Dieses bahnbrechende Finanzinstrument könnte die Art und Weise verändern, wie Kapital in saubere Energieprojekte in Entwicklungsländern fließt, und einen Weg schaffen, auf dem Technologie und Nachhaltigkeit gemeinsam gedeihen können.

Zero-Downtime Data Center Migration: Der ultimative Leitfaden für einen Umzug ohne Ausfallzeiten

In der heutigen schnelllebigen digitalen Landschaft kann ein einziger Fehltritt bei der Migration des Rechenzentrums zu kostspieligen Ausfallzeiten und unzufriedenen Beteiligten führen. Dieser Leitfaden bietet einen schrittweisen Ansatz, der die Bildung eines Teams, detaillierte Bestandsaufnahmen, Risikominderung und schrittweise Umstellungen umfasst, um sicherzustellen, dass Ihre Systeme voll funktionsfähig bleiben. Unabhängig davon, ob Sie alte Server aufrüsten oder in die Cloud verlagern, helfen Ihnen diese Best Practices dabei, eine unterbrechungsfreie und pünktliche Migration durchzuführen.

Heiß trifft auf kalt: Der epische Showdown bei der Kühlung Ihres Rechenzentrums

Tauchen Sie ein in den epischen thermischen Showdown in modernen Rechenzentren. Entdecken Sie, wie Warm- und Kaltgangeinhausung die Kühleffizienz revolutioniert, die Energiekosten um bis zu 40 % senkt und die Lebensdauer der Geräte verlängert. Ich nehme die neuesten ASHRAE-Richtlinien unter die Lupe und kläre die Debatte zwischen HAC und CAC ein für alle Mal - mit ein paar Kriegsgeschichten aus dem Serverraum als Zugabe.